Nachdem wir die Funktionsweise von Künstlicher Intelligenz (KI) in einer Serie behandelt hatten, wollen wir nun einen weiteren Blick in die Zukunft des Designens werfen. Wie wird KI die Arbeit von Mediengestaltern, Illustratoren oder Fotografen verändern? Wird Künstliche Intelligenz ausführendes Organ des Menschen sein oder der Mensch Redakteur der KI-Ergebnisse? Nach den Phasen der Digitalisierung und Virtualisierung in der Computerwelt bricht nun die Stunde der Künstlichen Intelligenz an.

Veränderungen in den Berufsfeldern „Illustration“ und „Foto-Design“

Vorgezeichnet ist eine Grenzverschiebung zwischen den Design-Berufen. Vor allem die Grenze zwischen Illustration und Fotografie wird verändert, weil synthetisch erzeugte KI-Bilder wie Fotos wirken können. Andererseits kann eine KI bestehende Kunst-Stile nachahmen und wird zukünftig wohl eigene virtuelle Strichführungen entwickeln – und damit stilbildend wirken. So könnte die nahe Zukunft eine Konkurrenz zwischen Fotografen und Designern etablieren. Mediengestalter würden dann über die KI ihrer Gestaltungssoftware die gewünschten Bilder gleich mit erzeugen.

Möglicherweise gibt es aber auch ein gleich verteiltes Nebeneinander zwischen menschengemachter Fotografie und KI-„Fotos“. Aktuelle Mode etwa wird wohl weiterhin von Menschen fotografiert.

Fotografie ohne Gewähr: Wie realistisch ist ein Foto?

Überhaupt muss man angesichts der KI vieles neu denken. Künstliche Intelligenz wird auch menschenunabhängig Bilder erzeugen, die realistisch, hyperrealistisch oder täuschend echt manipuliert sind. Was also eine Fotografie ist, ob synthetisch ohne Kamera erzeugt oder von Menschenhand aufgenommen, wird nach einer neuen Antwort verlangen.

Es ist davon auszugehen, dass die bildliche Darstellung zudem vorläufiger wird als bisher. Denn die KI kann Bilder noch einfacher und schneller verändern und wird diesen Prozess weiter vorantreiben.

3D-Realismus und Künstliche Intelligenz

Der Unterschied zwischen einer KI-erzeugten Produktabbildung und einer perfekt ausgeleuchteten Studiofotografie wird bei fortschreitender Technik immer weniger erkennbar sein. Auch die Trennlinie zwischen der Arbeit eines 3D-Designers, der Bilder per 3D-Software wie „Blender“ konstruiert, und einem Illustrator, der manuell auf Leinwand oder digital per Hand auf dem Grafik-Tablet malt, wird verschoben. Jedoch sind in der Werbe- oder Magazin-Illustration die Idee und der individuelle Ausdruck entscheidend, nicht die fotorealistische Perfektion. Der 3D-Designer jedenfalls macht die inzwischen unüberschaubare Fülle an vorhandenen 3D-Drahtgittermodellen zur Grundlage seiner Arbeit mit der KI. Während der bisherige Feinschliff für Beleuchtung und Materialität von Objekten im Rendering Zeit kostet, wird eine KI diesen Prozess beschleunigen und erleichtern und jenen Personengruppen zugänglicher machen, die bisher die Komplexität von 3D-Programmen wie „Cinema 4D“ gescheut haben. Vermutlich wird das Bildmaterial etwa für Kataloge, in denen konstruierte Gegenstände abgebildet werden, wie Autos, Möbel oder Spielsachen ohne Fotografen voll digital-synthetisch erstellt werden können. Und auch das strukturierte Design eines solchen Kataloges kann automatisiert werden. Der Mensch hätte dabei eine Funktion zwischen Konzeptioner und Art Director als nachregulierendem Design-Korrektor. Er wäre also initiierend für das Design-Konzept zuständig und würde während der Ausführung durch die KI in Kooperation mit ihr die Qualitätssicherung sicherstellen.

Motion-Design: Von der Statik zum Bewegtbild

Illustrations-Software hat es in der jüngeren Vergangenheit auch erleichtert, illustrierte Figuren zu animieren. Künstliche Intelligenzen erzeugen nicht nur statische Bilder sondern auch animierte und kurze Realfilme. So wird die Grenze zwischen Statik und Bewegung bei Illustration und Fotografie fließend. KI-erzeugte Illustrationen werden leichter als bisher in Motion-Design für Werbe-Clips oder Konzert-Projektionen übergehen.

Zusammenarbeit von Mensch und KI

Überall wo der Mensch nicht mehr eingreifen würde, könnte eine Bild- oder Gestaltungs-Ästhetik entstehen, die zu wenig menschenkompatibel ist und deshalb Zielgruppen nicht anspricht. Die Vorstellung also, eine visuelle KI könnte alles alleine machen, verkennt, dass es ihr schwerfallen würde, den permanenten Wandel kultureller Strömungen zu erfassen. Eine gute Frage an eine Hochleistungs-KI wäre etwa: Könnte sie jede Saison neue Mode entwerfen, die dem Geschmack der Leute entspräche? Vermutlich wird sie dies aus jetziger Sicht nicht können. Wohl aber kann sie ein beschleunigendes Werkzeug im Design-Prozess eines Modeschöpfers werden.

Die Künstliche Intelligenz als kooperatives Design-Werkzeug

Inzwischen wäre es möglich, bei Gruppenfotoaufnahmen alle Personen durch KI-Manipulation lächeln zu lassen, Falten in Gesichtern zu tilgen aber die Poren der Haut dennoch beizubehalten, um damit eine Realitätstreue zu simulieren.

KI wird vieles ermöglichen, was der Medien-Gestalter längst herbeigesehnt hat. Selbst bei Reportage-Fotografie für ein Magazin könnte der Designer per Prompt eingreifen. Änderungen wie „Lass die Straßenlaterne heller scheinen“, „Mach die Straße länger und lass sie im Nebel auslaufen“ oder „Füge ein auf der Straße fahrendes Auto mit Bewegungsunschärfe hinzu“ könnten schnell ausgeführt werden. Damit das qualitativ hochwertig klappt, müssen sich die KIs aber weiter perfektionieren. Doch Künstliche Intelligenz ist jetzt schon aktiver, als man denkt.

Bekannt geworden ist der Fall eines Smartphone-Herstellers, dessen KI-Software Fotos vom Mond eines Nutzers ohne sein Wissen durch schärfere und detailreichere Abbildungen ersetzte, also solche, die der Handynutzer gar nicht real aufgenommen hatte. Die KI hatte das unscharfe Motiv erkannt und einfach durch ein schärferes ersetzt.

Verfügbare KIs

Für Aufmerksamkeit gesorgt hatte mit „ChatGPT“ zunächst ein KI-System, das durch seine kommunikativen Fähigkeiten aufgefallen ist und auch durch seine Fähigkeit, professionell Texte zu formulieren. Geschaffen wurde dieses „Large Language Model“ vom Unternehmen „OpenAI“, das auch die bilderzeugende „Dall-E“-KI entwickelt hat. Inzwischen werden zahlreiche KI-Apps angeboten, wobei fast alle keine selbst entwickelte KI für ihre Software nutzen. Meist wird auf die kostenlose Open-Source-KI „Stable Diffusion“ zurückgegriffen, manchmal auch auf „Midjourney“ oder „Dall-E“. Deren Bildgenerierungs-Fähigkeiten ermöglichen es selbst Nicht-Illustratoren oder Nicht-Fotografen Bilder zu erstellen. Mittels einer Bildbearbeitungs-Software mit KI lässt sich zukünftig auch bestehendes Bildmaterial verändern. Der Facebook-Konzern „Meta“ etwa hat mit „Make a Scene“ eine KI geschaffen, die zusammen mit dem Prompt einfachste Skizzen als Grundlage der Bildkomposition nutzt, damit das Ergebnis genauer und zielgerichteter wird.

Adobe-„Firefly“-Fähigkeiten

Für Designer aber noch interessanter war Adobes Ankündigung, mit ihren KIs „Firefly“ und „Gingerbread“ spezifischer auf die Bedürfnislage von Gestaltern einzugehen. Bei diesen Adobe-KIs geht es schwerpunktmäßig um die Erzeugung von Bildern. Dann aber auch um deren möglichst genaue und detaillierte Veränderbarkeit. Ein weiterer Schritt ist die Implementierung dieser intelligenten Funktionen in die „Adobe Creative Cloud“, vor allem in Photoshop (ab Version 24.6.) und Adobe Illustrator. Jetzt und zukünftig werden Funktionen wie die nachfolgenden verfügbar sein:

- Text zu Bild: Bilder per Text-Prompt erzeugen.

- Text zu Vektor: Die KI kann nicht nur Pixelbilder erstellen sondern auch Vektorgrafiken.

- Text zu Pinsel: Man kann den Pinselstrich über eine Texteingabe festlegen, etwa dem Pinsel ein Blumenblüten-Motiv zuweisen, sodass der Pinselstrich aus Blüten besteht.

- Text zu Muster: Ebenso lassen sich Muster erzeugen.

- Text zu Vorlage: Hier lassen sich Vorlagen für Glückwunschkarten oder andere Drucksachen erstellen.

- Bildanpassung per Textanweisung: z.B. Beleuchtung oder Farbigkeit eines Bildes.

- Generative Füllung: Mit dem Pinsel Elemente hinzufügen oder löschen.

- Bilddetails ändern: Kleidung in Foto-Motiven tauschen, Früchte an Bäumen oder Brillen auf Gesichtern.

- Texteffekte: Schriften mit Materialität oder Bildern kombinieren, etwa Buchstaben mit virtuellem Fell überziehen.

- Generative Neueinfärbung: Farbvarianten von Vektorgrafiken anfertigen lassen.

- Skizze zu Grafik: Aus einer groben Skizze wird ein synthetisch erstelltes Bild.

- 3D zu Bild: Auf der Grundlage eines 3D-Drahtgittermodelles ein fotorealistisches Bild rendern oder um Objekte erweitern.

- Bild erweitern: Dabei werden gelöschte Elemente automatisch mit einem von der KI ergänzten und der Bildmotivik angepassten Hintergrund ersetzt.

- Smart Portrait: Hier lassen sich per Schieberegler z.B. Alter oder Ausdruck eines Gesichtes ändern.

- Bilderstellung mit Farbvorlage: Ein Bild hochladen und dessen Farbanmutung auf selbst generierte Bilder übertragen.

- Hochskalieren: Die Datengröße und Auflösung eines Bildes vergrößern.

- Fotos kombinieren: mehrere Bilder hochladen und die KI daraus ein neues Gesamtbild machen lassen.

Die Fähigkeiten der Adobe-„Gingerbread“-KI

Mit „Gingerbread“ hat Adobe zudem eine Erweiterung für „Firefly“ geschaffen – als eine Spezial-Anwendung für die Einbindung und Erstellung von 3D-Szenen. Auf der funktionalen Ebene werden Drahtgittermodell-Geometrien genutzt und gerendert. Allerdings nur als Grundlage, weil das Ergebnis wieder gepromptete also per Texteingabe erzeugte und veränderte Bilder mit fotorealistischer Qualität sind. Mit „fotorealistisch“ ist hier gemeint, dass die Trennlinie zur Fotografie überschritten wird. Wer weiß, wie aufwendig und teuer etwa die Autofotografie ist, der kann sich vorstellen, dass Autos für die Werbung zukünftig möglicherweise nicht mehr fotografiert oder gefilmt, sondern anhand der Konstruktions-Zeichnungen in 3D-Modelle umgewandelt werden, die per KIs wie „Gingerbread“ fotorealistisch ausgegeben werden – so perfekt, dass sie von einer hochklassigen Fotografie nicht mehr zu unterscheiden wären.

Web-Design und Print-Design

Die KI könnte nämlich gerade dort schnell größere Auswirkungen haben, wo der Grad der Digitalisierung weit fortgeschritten ist. Also etwa mehr im vollständig virtualisierten Web-Design als im Print-Design mit seinem physischen Endergebnis. Zumal man per Prompt-Texteingabe etwa in einer KI wie „Google Bard“ auch Programm-Code erzeugen kann – was beim Web-Design Gestaltung und Programmierung noch mehr miteinander verschmelzen wird.

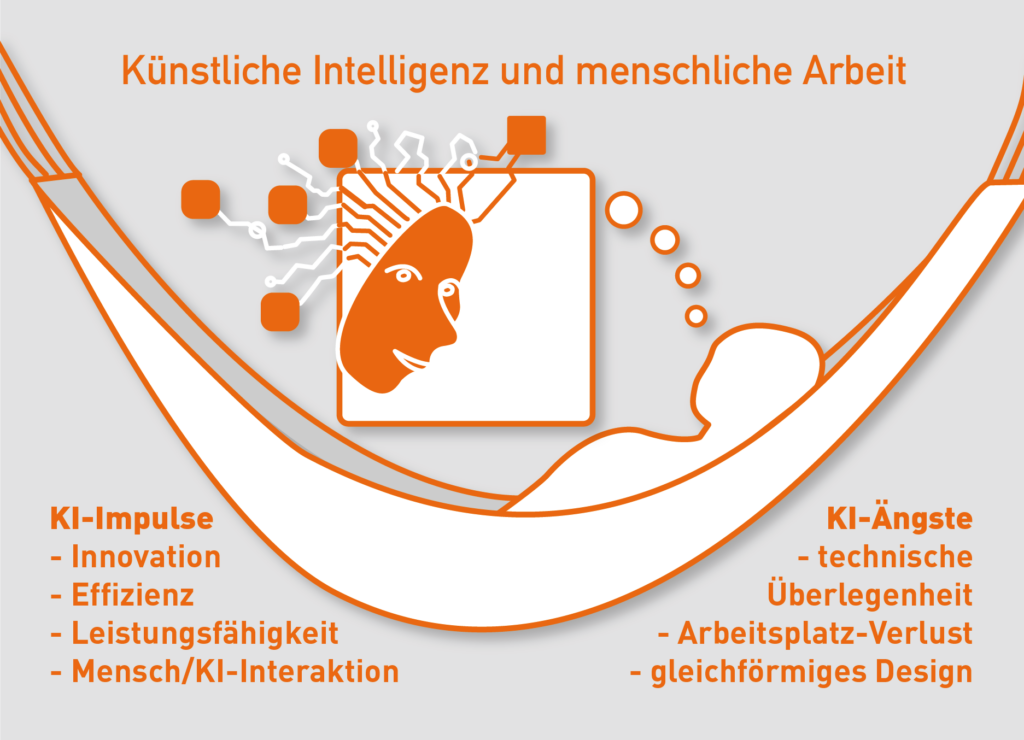

KI als Werkzeug oder als Menschenersatz?

Ökonomisch betrachtet hat Technologie der westlichen Welt einen erheblichen Produktivitätszuwachs gebracht und damit einen relativen Wohlstand im Verhältnis zu weniger entwickelten Ländern. Der digitale Wandel hat Prozesse rationalisiert, effizienter gestaltet und beschleunigt. Bisher hat diese anwachsende Produktivität durch technische Innovation immer mehr Arbeitsplätze geschaffen. Einerseits wird Künstliche Intelligenz ein Produktivitäts-Motor sein, andererseits durch Rationalisierung Berufsbilder verändern oder wegfallen lassen. Allerdings ist unklar, ob der technologische Quantensprung, der die Künstliche Intelligenz wohl sein wird, nicht doch so erheblich ist, dass er mehr menschliche Arbeitsplätze überflüssig macht, als dass er neue schafft.

Fazit

Jede KI, die jetzt und in absehbarer Zukunft tätig wird, ist spezialisiert. KIs werden in diversen Bereichen des Gestaltens agieren, etwa bei:

- Entwurf von Logos

- Schriftentwicklung

- Anzeigen-Werbung

- Editorial-Design

- Kleindrucksachen wie Geschäftspapieren oder Glückwunsch-Karten

- Reinzeichnung nach Layout-Entwürfen

Solche Spezialisierungen können langfristig eine multifunktionale Design-KI bilden. Zu bedenken ist aber, dass eine höhere technische Komplexität auch mehr Expertenwissen auf Anwenderseite erfordert. KI kann zwar die Handhabung von Funktionalitäten revolutionieren, dennoch werden erweiterte Berufsbilder entstehen, die die Möglichkeiten und Begrenzungen Künstlicher Intelligenz handhaben.

Wer die Möglichkeiten von KI als Erweiterung seiner Fähigkeiten ansieht und den Einsatz dieses Werkzeugs lernt, qualifiziert sich. Dennoch werden Arbeitsplätze in verschiedenen Bereichen wegfallen und neuartige entstehen. Der Beruf des Mediengestalters wird sich noch rasanter ändern als bisher. Langfristig werden gleichförmige Tätigkeiten beim Gestalten durch Künstliche Intelligenz verdrängt, während Erfahrung bei der Mensch-/System-Interaktion gefragt sein wird. Regelbasiertes, strukturiertes Gestalten für Bücher, Kataloge, Magazine und serielle Drucksachen-Produktion wird starke Konkurrenz durch die Fähigkeiten der KI bekommen. Betriebe wie Setzereien oder Fotostudios werden es zukünftig schwerer haben. Kleine Kreativbüros könnten durch die neue Technik leistungsfähiger werden, ebenso experimentierfreudige Illustratoren und Fotografen. Große Design- und Werbe-Agenturen werden ihre Berufsbilder und Anforderungen an Freelancer anpassen. Vermutlich wird das Medien-Design langfristig gleichförmiger und austauschbarer, wenn die KIs Gestaltungskonzepte verinnerlicht haben und diese massenhaft ausspielen.